Pour la première fois, une étude scientifique, menée par une équipe de recherche multidisciplinaire de l’Université d’Oxford, affirme que le développement de l’Intelligence artificielle représente la principale menace d’extinction de la civilisation humaine. Mythe ou réalité ?

* * *

L

ES 12 scénarios possibles de la fin du monde. Le titre, aux accents apocalyptiques, est celui du rapport publié en février dernier par des chercheurs de la Global Challenges Foundation et du Future of Humanity Institute, de l’Université d’Oxford.

Près de 200 pages, destinées à la communauté scientifique et aux gouvernements, qui dressent une liste des menaces que l’humanité pourrait un jour avoir à affronter. De la plus singulière − une attaque de la part d’extraterrestre − à la plus convenue − un changement climatique extrême.

la menace pourrait dépasser celle d’un changement climatique extrême ou d’une épidémie mondiale.

Afin de dégager les priorités, les scientifiques ont tenté d’évaluer, pour chaque risque, la probabilité qu’il se réalise. Au sommet de la liste ? Le danger de voir émerger une Intelligence artificielle (I.A)[1]− On parle aujourd’hui d’intelligences artificielles, au pluriel. Le terme, employé au singulier, désigne à la fois le domaine de recherche et, comme c’est le cas dans le … Continue reading qui supplanterait celle de son créateur.

La fourchette de probabilité − comprise entre 0 et 10 % − est large. Mais les fortes incertitudes qui entourent ce domaine font dire aux experts que la menace pourrait dépasser celle d’un changement climatique extrême (0,01 %) ou d’une épidémie mondiale (0,0001 %).

A en croire le rapport, l’I.A, dans sa forme la plus aboutie, s’apparenterait à une intelligence extrême rassemblant les diverses formes d’intelligences artificielles « déployées par les machines et logiciels ».

LA FIN DE L’HUMANITÉ ?

« Comparable à l’intelligence humaine », elle pourrait, à force d’accroître ses capacités, échapper à ses créateurs et prendre le pouvoir. Œuvrant alors dans son propre intérêt, qui ne serait pas forcément le nôtre, elle causerait la disparition de l’espèce humaine.

Ce scénario, digne des meilleurs films de science-fiction, est néanmoins parvenu à s’aménager une place de choix au rayon des peurs collectives.

D’éminents scientifiques, au rang desquels Stephen Hawkings, relayent ces inquiétudes. Coup sur coup, en mai et décembre derniers, l’astrophysicien britannique co-signait une tribune dans The Independent puis donnait une interview à la BBC, où il expliquait comment « l’I.A pourrait mettre fin à l’Humanité. »

l’Intelligence Artificielle pourrait mettre fin à l’Humanité.

En janvier, c’était au tour de la Future of Humanity − co-auteur du rapport − de publier une lettre ouverte, incitant les chercheurs à moins se préoccuper de développer les capacités de l’I.A et à davantage se pencher sur le bénéfice social à en tirer.

Elle insistait également sur la mise en place de garde-fous et lançait dans la foulée un appel à projet dans ce sens.

Des craintes justifiées ? « Si l’avènement du post-humain semble relever de la science-fiction, doit-on pour autant s’interdire de l’envisager ? », s’interroge le philosophe Jean-Michel Besnier.

« Aujourd’hui, l’I.A est partout : dans les jeux vidéos, les voitures sans conducteur, la prothèse d’Oscar Pistorius… Ce qu’on entend par « I.A », c’est la capacité pour un système de mettre en place des dispositifs capables de recevoir des signaux et d’en émettre. L’intelligence ici n’est pas la faculté de résoudre des problèmes grâce à la réflexion, comme chez les humains. C’est l’aptitude à réagir à des signaux. »

Or, « si la réactivité est la clé de notre fonctionnement, il faut bien dire que les machines sont plus réactives que nous. Que ce soit dans le domaine boursier, de la santé ou militaire. »

« La loi de Moore établit que nos machines doublent leur puissance tous les 18 mois. Elles vont également être amenées à prendre davantage d’initiatives. C’est là que pourrait survenir la catastrophe », pointe le philosophe, rappelant le rôle joué par les algorithmes dans le krach boursier de 2008 ou celui de 2010, à la Bourse de New-York.

Pour éviter un tel écueil, certains États se penchent déjà sur un « droit des robots ». La Corée du Sud, pionnière, s’y est attelée dès 2007. Le Japon et le Royaume-Uni ont suivi.

Il y a quatre mois, en France, le comité d’éthique de l’Alliance des sciences et technologies du numérique rendait son premier avis sur le sujet.

UNE RÉFLEXION ÉTHIQUE NÉCESSAIRE

Une réflexion éthique nécessaire et propice, selon Malik Ghallab, directeur de recherche en I.A et robotique au CNRS (Laboratoire d’analyse et d’architecture des systèmes, LAAS). A condition de s’attacher aux véritables risques.

Certes, l’apprentissage automatique − la possibilité pour un système d’acquérir par lui-même les paramètres nécessaires pour effectuer une tâche donnée − a fortement progressé.

La vraie menace aujourd’hui réside dans l’automatisation des tâches et la montée du chômage. Une tendance qui va se poursuivre avec le développement de l’intelligence artificielle.

« Mais ce n’est pas parce qu’on ne programme plus entièrement la machine qu’on ne la contrôle pas. Concernant le pilotage automatique d’avions, par exemple, des techniques de certification permettent de garantir le respect de propriétés de sécurité désirées, comme d’éviter les phases de vols les plus risquées. »

Aujourd’hui, « le danger n’est pas dans la transgression de l’homme par la machine. Mais dans les transgressions de l’homme avec l’aide de la machine. C’est l’homme qui développe les machines et détermine leur objectif », insiste le scientifique.

Et c’est souvent cet objectif, tourné vers la rentabilité, qui s’avère néfaste. « La vraie menace aujourd’hui réside dans l’automatisation des tâches et la montée du chômage. Une tendance qui va se poursuivre avec le développement de l’I.A. Mais elle ne se trouve certainement pas dans l’émergence d’une Intelligence singulière », professe le chercheur.

« Il existe une multitude de programmes d’I.A, chacun adapté à une tâche particulière. Or, les efforts nécessaires pour les intégrer en une seule entité cohérente seront sans commune mesure avec ceux déployés pour les développer. C’est une chimère. »

Que penser alors de l’annonce faite par Ray Kurzweil , tête chercheuse de Google, de l’avènement d’une super-conscience — « la Singularité » − d’ici 2029 ?

Elle « ne s’appuie sur aucune preuve scientifique », affirme Philippe Souères, directeur de recherche au CNRS et spécialiste de robotique humanoïde au LAAS.

Bien plus, « la question d’une intelligence artificielle désincarnée n’a aucun sens. La perception (ouïe, toucher…) est fondamentale. C’est le corps qui relie le logiciel au monde réel et nous donne une vision unifiée de notre environnement. Sans cela, il reste un hyper-programme de traitement d’informations. »

On sait concevoir un robot comme Deep Blue, capable de battre les plus grands champions d’échecs, mais faire qu’il saisisse la Reine avec sa main dans des environnements différents reste plus difficile.

« Les robots commencent tout juste à marcher et grimper des escaliers − des mouvements dynamiques complexes. On ne peut pas parler d’intelligence. D’ailleurs, on ne sait toujours pas bien ce que c’est. Comment voulez-vous qu’on en crée ? »

Le doute, pourtant, s’insinue. « Réseaux neuronaux », « connexions synaptiques », etc. A force de comparer le fonctionnement de l’ordinateur à celui de la pensée, on en est venu à assimiler l’un à l’autre. A tel point, selon Philippe Souères, que « certains se sont pris à rêver ».

C’est ainsi que le Human Brain Project, projet-phare de l’Union Européenne, a vu le jour en 2013. Ce programme ambitieux, qui visait à recréer un cerveau artificiel à partir d’algorithmes, a vite été remis en question par une partie des acteurs du projet eux-mêmes.

L’objectif, redéfini a minima, s’attache désormais à produire une base de données rassemblant les diverses études réalisées en neurosciences.

« UNE VISION PAUVRE DE L’HUMAIN »

« Les chercheurs prennent le potentiel informatique au sérieux. Mais ont-ils la distance nécessaire ? », s’interroge le philosophe Daniel Cérézuelle. « Les hommes ont toujours projeté sur les dispositifs de communication leurs désirs d’une transmutation de l’existence. Ce qui est étonnant, c’est que la frontière entre le rationnel et l’irrationnel soit précisément effacée par une démarche scientifique ! »

« Au fond, les lanceurs d’alerte comme Stephen Hawkings ont en commun avec les prêtres du transhumanisme la même conviction que le dépassement humain est possible. Nous sommes là dans des rêves démiurgiques, souligne l’auteur de l’essai La Technique et la chair. Mais pour s’imaginer que ce que font les machines correspond au fonctionnement de notre intelligence, il faut tout de même, en tant qu’humain, avoir une vision bien pauvre de soi-même. »

Floriane Leclerc, journaliste / Sciences Critiques.

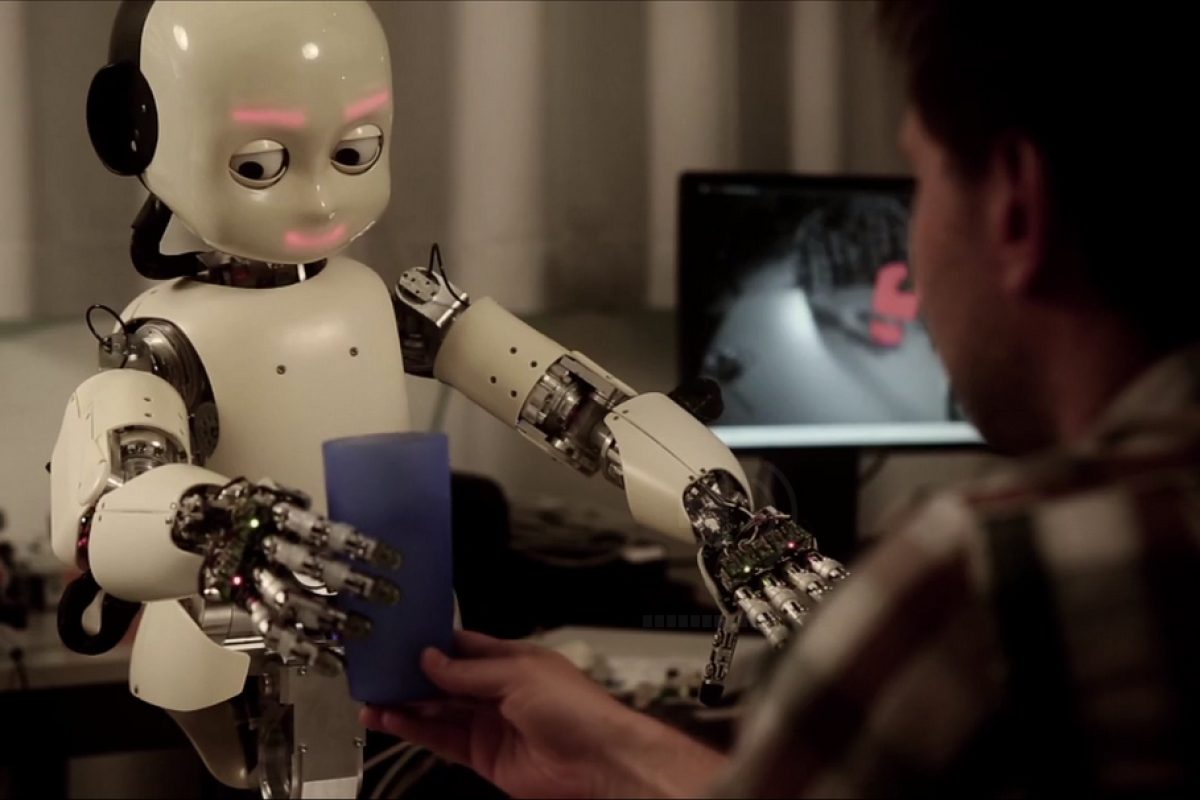

> Photo à la Une : un robot humanoïde iCub tente de saisir un verre lors d’une expérience à l’Institut Dalle Molle pour la Recherche en Intelligence Artificielle, en Suisse.

* * *

Notes[+]

| ↑1 | − On parle aujourd’hui d’intelligences artificielles, au pluriel. Le terme, employé au singulier, désigne à la fois le domaine de recherche et, comme c’est le cas dans le rapport, une « intelligence artificielle singulière » extrême, rassemblant toutes les autres formes d’Intelligences artificielles. / |

|---|

4 réponses

Qu’est-ce que vivre? C’est éprouver, sentir, s’émouvoir, penser. Si grâce à l’IA on finit pas construire des humanoïdes plus performants que les humains, en science, en musique, en arts plastiques, en sport mais que ces robots ne soient que des » grille-pain » comme le disent les humains de la série » Battlestar Galactica », alors oui, il faut prendre toutes les mesures pour que l’IA ne fasse pas disparaître l’humanité, ou les abeilles.

Mais s’ils étaient pourvu de sensibilité, d’émotions, d’enthousiasme, alors qu’importe la disparition de l’humanité. Une symphonie, une œuvre d’art, un film ou tout simplement la vue de personnes qui s’aiment peuvent me mettre les larmes aux yeux et c’est cela qui compte, « L’important, c’est la rose ». Encore faut-il quelqu’un pour l’admirer, la respirer. Et si un jour, les robots en deviennent capables, alors qu’importe la disparition des humains avec son lot de tortionnaires, de cupides, d’avides et de fous du pouvoir.

Ou alors, il faut espérer pouvoir vivre dans la Culture : https://yannickrumpala.wordpress.com/2009/10/02/lanarchie-dans-un-monde-de-machines/

Merci pour toutes ces infos, voici une bonne lecture. J’ai appris différentes choses en vous lisant, merci à vous. Fabienne Huillet http://www.neonmag.fr

La science ne pense pas disait fort justement Heidegger mais elle dépense certainement beaucoup !